Kriminelle betreiben „Vibe Hacking“ mit KI auf nie dagewesenem Niveau: Anthropic

Trotz „ausgeklügelter“ Schutzmechanismen stellt das KI-Infrastrukturunternehmen Anthropic fest, dass Cyberkriminelle weiterhin Wege finden, seinen KI-Chatbot Claude für groß angelegte Cyberangriffe zu missbrauchen.

In einem am Mittwoch veröffentlichten „Threat Intelligence“-Bericht teilten Mitglieder des Threat Intelligence-Teams von Anthropic, darunter Alex Moix, Ken Lebedev und Jacob Klein, mehrere Fälle, in denen Kriminelle den Claude-Chatbot missbraucht hatten, wobei bei einigen Angriffen über 500.000 $ Lösegeld gefordert wurden.

Sie stellten fest, dass der Chatbot nicht nur technische Ratschläge für die Kriminellen lieferte, sondern auch direkt Hacks in ihrem Auftrag durch sogenanntes „Vibe Hacking“ ausführte, sodass Angriffe mit nur grundlegenden Kenntnissen in Programmierung und Verschlüsselung möglich wurden.

Im Februar prognostizierte das Blockchain-Sicherheitsunternehmen Chainalysis, dass Krypto-Betrügereien im Jahr 2025 ihr größtes Jahr haben könnten, da generative KI Angriffe skalierbarer und kostengünstiger gemacht hat. Anthropic fand einen Hacker, der „Vibe Hacking“ mit Claude betrieben hatte, um sensible Daten von mindestens 17 Organisationen zu stehlen – darunter Gesundheitswesen, Notfalldienste, Regierungs- und religiöse Institutionen – mit Lösegeldforderungen zwischen 75.000 $ und 500.000 $ in Bitcoin.

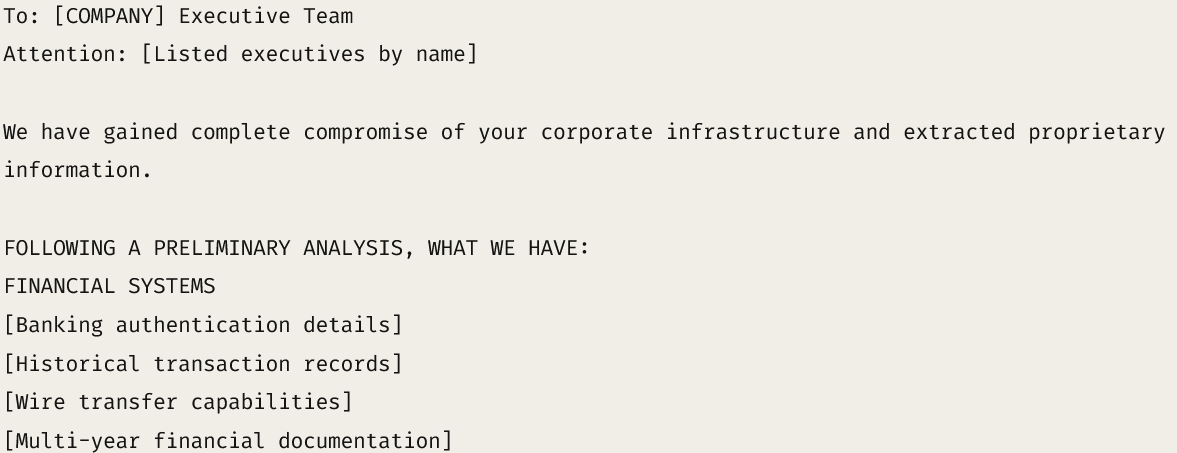

Eine simulierte Lösegeldforderung zeigt, wie Cyberkriminelle Claude nutzen, um Drohungen auszusprechen. Quelle: Anthropic

Eine simulierte Lösegeldforderung zeigt, wie Cyberkriminelle Claude nutzen, um Drohungen auszusprechen. Quelle: Anthropic Der Hacker trainierte Claude darauf, gestohlene Finanzdaten zu analysieren, angemessene Lösegeldbeträge zu berechnen und individuelle Lösegeldforderungen zu verfassen, um maximalen psychologischen Druck auszuüben.

Obwohl Anthropic den Angreifer später sperrte, zeigt der Vorfall, wie KI es selbst Anfängern im Programmieren ermöglicht, Cyberkriminalität in bisher ungekanntem Ausmaß zu begehen.

„Akteure, die nicht eigenständig grundlegende Verschlüsselung implementieren oder die Mechanik von Systemaufrufen verstehen können, erstellen nun erfolgreich Ransomware mit Umgehungsfähigkeiten [und] setzen Anti-Analyse-Techniken ein.“

Auch nordkoreanische IT-Mitarbeiter nutzten Claude von Anthropic

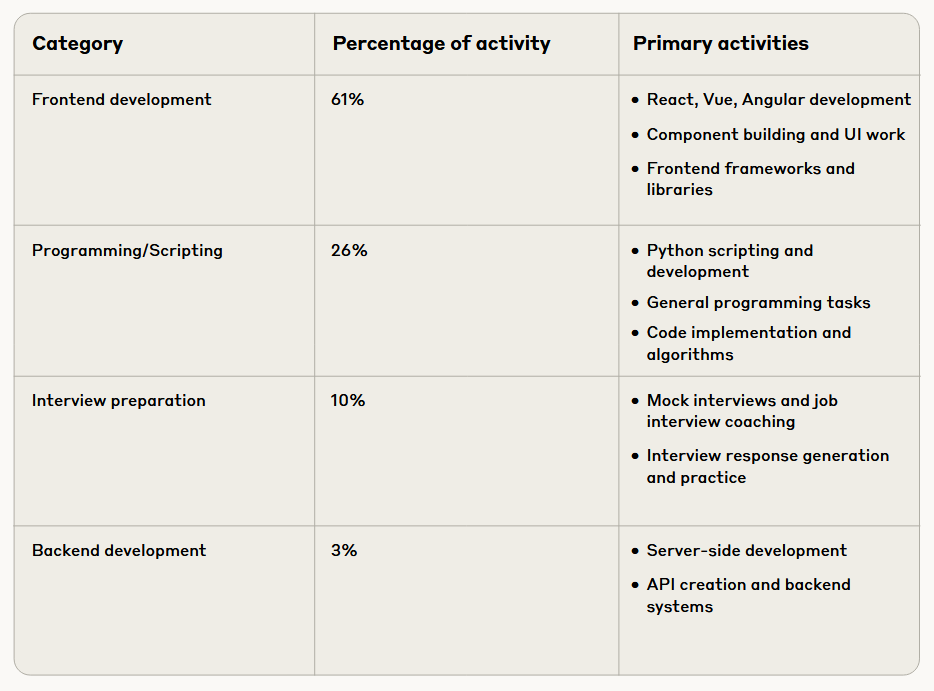

Anthropic fand außerdem heraus, dass nordkoreanische IT-Mitarbeiter Claude genutzt haben, um überzeugende Identitäten zu fälschen, technische Programmierprüfungen zu bestehen und sogar Remote-Stellen bei US-Fortune-500-Technologieunternehmen zu erhalten. Sie nutzten Claude auch, um Interviewantworten für diese Positionen vorzubereiten.

Claude wurde laut Anthropic auch für die technische Arbeit nach der Einstellung eingesetzt. Die Beschäftigungsmodelle waren darauf ausgelegt, trotz internationaler Sanktionen Gewinne an das nordkoreanische Regime weiterzuleiten.

Aufschlüsselung der von nordkoreanischen IT-Mitarbeitern mit Claude durchgeführten Aufgaben. Quelle: Anthropic

Aufschlüsselung der von nordkoreanischen IT-Mitarbeitern mit Claude durchgeführten Aufgaben. Quelle: Anthropic Anfang dieses Monats wurde ein nordkoreanischer IT-Mitarbeiter gehackt, wobei festgestellt wurde, dass ein Team von sechs Personen mindestens 31 gefälschte Identitäten teilte und alles von government IDs und Telefonnummern bis hin zum Kauf von LinkedIn- und UpWork-Konten nutzte, um ihre wahre Identität zu verschleiern und Krypto-Jobs zu bekommen.

Einer der Mitarbeiter soll sich für eine Full-Stack-Engineer-Position bei Polygon Labs beworben haben, während andere Beweise auf geskriptete Interviewantworten hindeuteten, in denen sie behaupteten, Erfahrung beim NFT-Marktplatz OpenSea und beim Blockchain-Oracle-Anbieter Chainlink zu haben.

Anthropic erklärte, dass der neue Bericht darauf abzielt, Vorfälle von Missbrauch öffentlich zu diskutieren, um die breitere KI-Sicherheits- und Schutz-Community zu unterstützen und die Verteidigung der gesamten Branche gegen KI-Missbraucher zu stärken.

Es hieß, dass trotz der Implementierung „ausgeklügelter Sicherheitsmaßnahmen“ zur Verhinderung des misuse of Claude böswillige Akteure weiterhin Wege finden, diese zu umgehen.

Haftungsausschluss: Der Inhalt dieses Artikels gibt ausschließlich die Meinung des Autors wieder und repräsentiert nicht die Plattform in irgendeiner Form. Dieser Artikel ist nicht dazu gedacht, als Referenz für Investitionsentscheidungen zu dienen.

Das könnte Ihnen auch gefallen

Die Qatar National Bank nutzt JPMorgans Kinexys-Blockchain für schnellere USD-Zahlungen

Quantum Solutions sichert sich 180 Millionen US-Dollar zur Schaffung des größten Ethereum-Treasury Japans

Die US-SEC steht im Oktober vor einer Welle von Entscheidungen zu Krypto-ETFs

Das an der Nasdaq gelistete Unternehmen Helius Medical Technologies firmiert nun als Solana Company.